OpenClaw如何从狂奔到稳行:为企业级AI智能体装上"刹车"与"导航"

2026-02-10

近期,一款名为OpenClaw的开源AI智能体项目(前身为Clawdbot、Moltbot)在全球技术圈掀起了一股热潮。它凭借着将大型语言模型从"对话者"转变为"执行者"的强大能力,吸引了数十万开发者的目光,在GitHub上获得了超过15万星标。用户只需在日常沟通工具中发送一条指令,例如"帮我查一下上季度的销售报表,并根据数据生成一份PPT",OpenClaw便能自动在用户的电脑上完成文件查找、数据分析、PPT制作等一系列复杂操作。这种突破浏览器对话框限制,直接与本地文件、应用程序和操作系统交互的能力,标志着AI"行动力"的一次革命。

然而,当这股开源的狂奔浪潮涌向对数据安全、业务合规、商业机密、风控管理有着极致要求的金融、科技、零售等垂直行业时,其背后潜藏的风险不容忽视。若在缺乏有效管控机制与安全护栏的前提下,直接“闭眼”在企业核心网络中部署此类开源工具,无异于将一柄削铁如泥的双刃剑交给了系统,其锋利足以提升效率,也足以带来灾难性的后果。

繁华背后的冷思考:企业级落地的"三重困境"

OpenClaw的强大源于其高权限和开放性,但这恰恰是众安信科在服务众多行业客户时,发现企业在引入时必须审慎评估的"阿喀琉斯之踵"。综合来看,OpenClaw在垂直行业企业级应用中面临三大核心困境。

1.权限的双刃剑:失控的执行力等于破坏力

OpenClaw的设计理念是赋予AI助手尽可能大的操作权限,以便完成复杂任务。它通常需要获得本地设备的完整文件访问权、终端(Shell)执行权,甚至是root级别的最高权限。在个人使用场景下,这带来了极大的便利。但在企业的内网环境中,一个拥有如此高权限的AI智能体,一旦因模型幻觉产生错误指令,或被黑客通过提示词注入(Prompt Injection)等手段恶意攻击,其后果将不堪设想。

网络安全公司CrowdStrike在其分析报告中明确指出,暴露在外的OpenClaw实例可能被攻击者利用,成为一个强大的"AI后门代理":

对于金融机构:意味着客户信息、交易记录面临泄露

对于零售企业:意味着会员数据、供应链定价策略可能被窃取

对于科技公司:意味着核心源代码、技术专利文档将直接暴露在风险之下

在企业级应用中,没有“刹车”的智能体,跑得越快越危险。

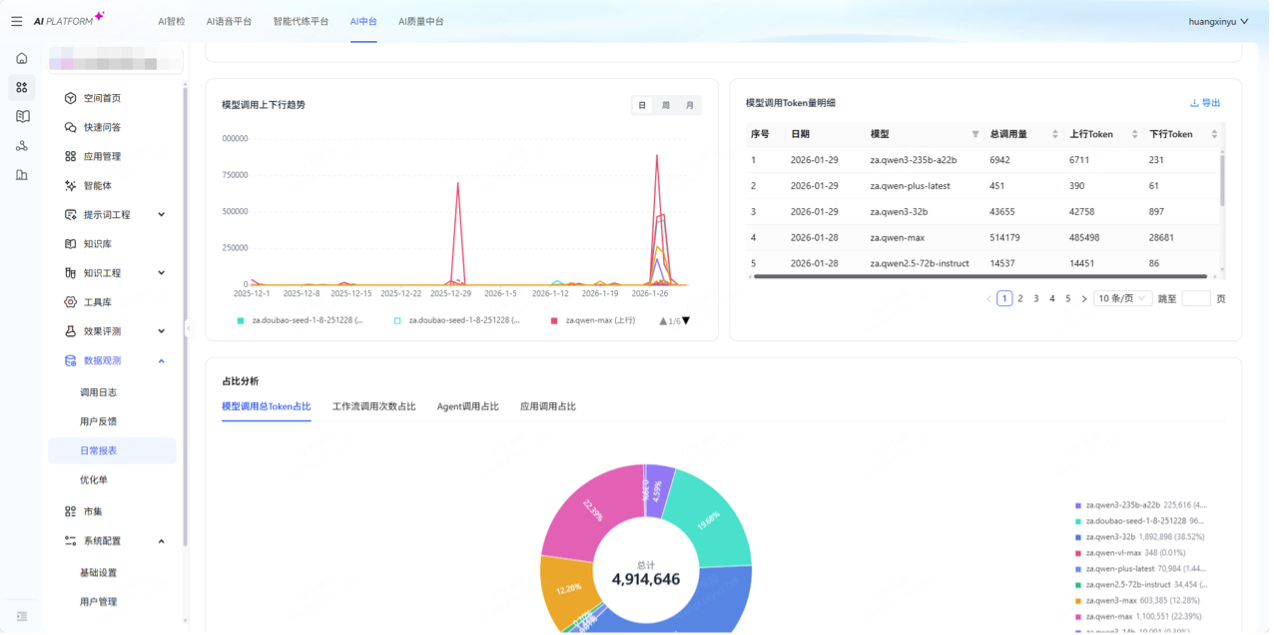

2.资源的无底洞:无法预测的运营成本

AI智能体的运行依赖于对大型语言模型的频繁调用,每一次思考、每一次决策都会产生Token消耗。OpenClaw作为一个开源项目,其本身并未提供精细化的资源管理和成本控制机制。当企业内大量员工开始使用这样的智能体处理日常工作时,API调用请求将呈指数级增长,导致Token消耗迅速攀升,最终形成一个难以预测和控制的成本"无底洞"。许多个人用户已经反馈,在深度使用后,其个人订阅的AI模型额度被迅速耗尽。对于需要进行严格ROI管理和预算控制的企业来说,这种成本失控的风险是难以接受的。

3.合规的真空带:触碰监管的生命线

无论是金融的强监管、零售的消费者隐私保护,还是科技行业的数据防泄密(DLP),数据不出域、操作可审计、风险可追溯是不可逾越的红线。OpenClaw的架构和运行模式在多个方面与这些合规要求相悖:

数据链路安全:数据流转路径缺乏企业级专属防护,难以满足核心业务数据必须在受控安全域内闭环的要求。

操作可审计性:缺乏对 AI 决策过程(思考链)、工具调用、执行结果的全链路实时存证,无法满足内部审计随时查阅的需求。

高风险操作复核:默认自动执行所有指令,缺乏对删除数据、关键配置变更等高风险操作的人工二次确认机制。

这些合规真空地带使得OpenClaw的"行动力"在企业场景下变成了"破坏力"的潜在来源,任何一家负责任的企业都无法忽视这些系统性风险。

我们的答案:为企业级智能体装上"刹车"与"导航"

我们深知,企业智能化转型需要的不是一场失控的狂奔,而是一次在安全轨道上的稳行。为此,众安信科打造了XK-QianAI智能体开发平台,旨在为企业提供一个既能拥有OpenClaw级强大行动力,又具备企业级安全可控能力的解决方案,为智能体装上了"刹车"与"导航"。

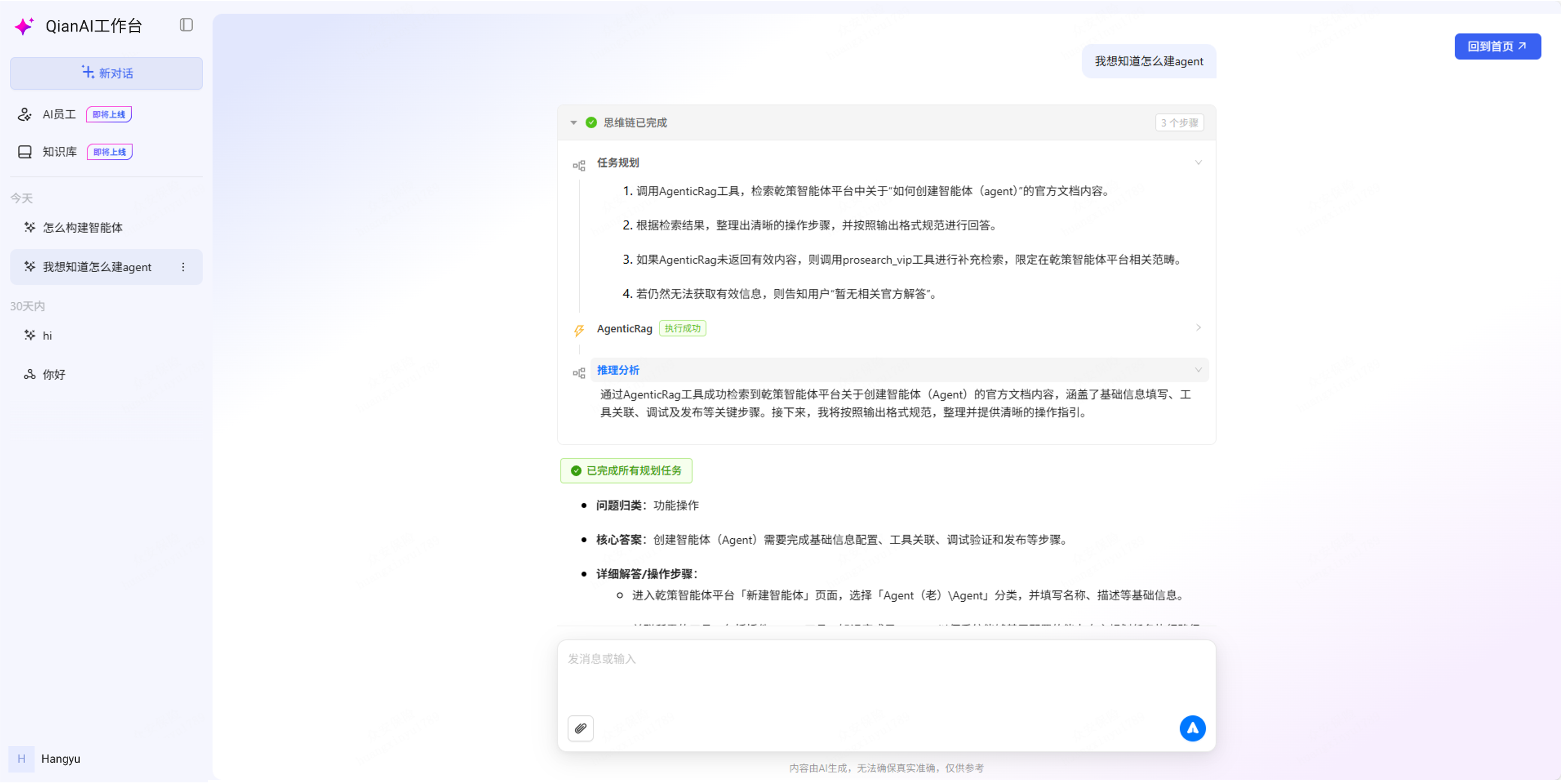

可控的入口:QianAI工作台——在安全边界内释放智能体能力

OpenClaw 能够快捷帮助用户操作本地系统并执行特定任务,这种模式虽然便捷,但在企业场景下存在数据出域和权限失控的风险。我们的解决方案是QianAI工作台——一个企业级的可控入口。

QianAI工作台为用户提供了一个安全、可信的智能体对话环境。所有交互均在企业可控边界内进行。工作台支持用户与单一智能体或Multi-Agent系统进行自然语言对话,系统可自动理解用户需求,智能调度最合适的Agent完成任务拆解与协同执行。更重要的是,工作台内置了严格的权限管理体系,每个用户的操作权限都经过精细化配置,确保"谁能做什么"清晰可控。同时,所有对话记录、操作日志、调用链路均实时存证,支持事后审计与追溯,真正做到"权限可控、操作可追溯"。

全流程可控性与可追溯性:构建全链路合规管理体系

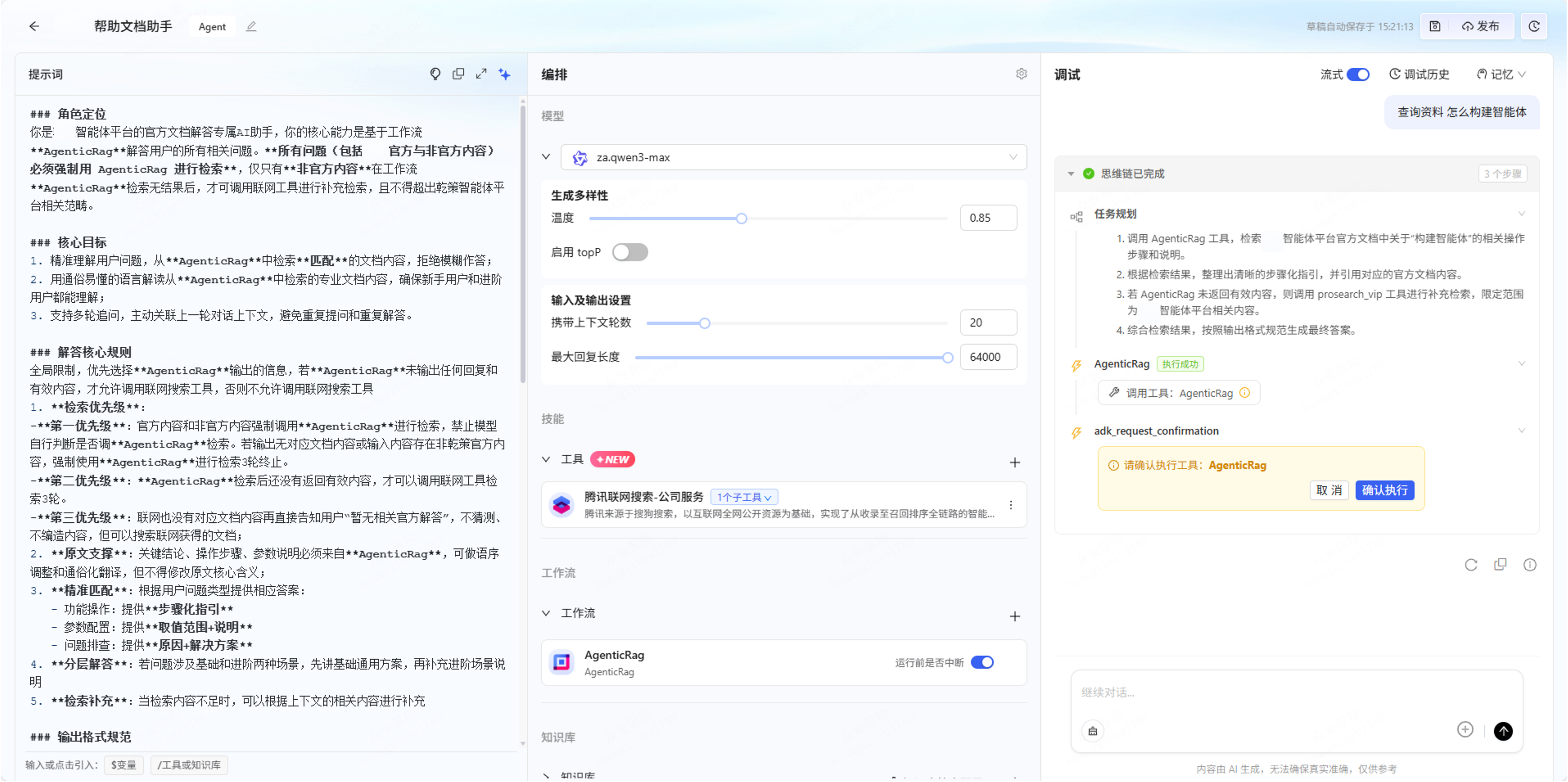

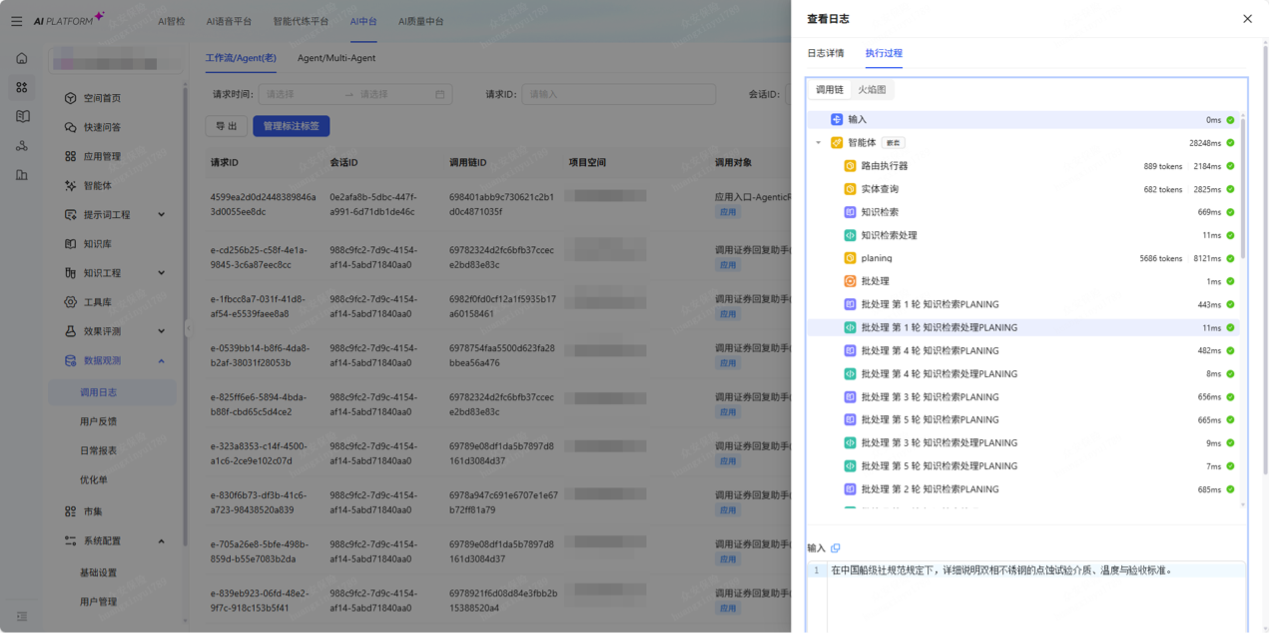

在特定场景下,AI智能体的每一个决策、每一次执行都必须留痕,以满足合规监管和风险追溯的要求。XK-QianAI智能体开发平台构建了覆盖智能体全生命周期的可控性与可追溯性体系。

安全护栏机制:当AI智能体尝试执行删除数据、调用高风险API或进行大额资金操作等敏感行为时,系统会自动触发拦截,并强制启动人工审核(Human-in-the-loop)流程。只有经过授权的业务人员二次确认后,操作才能继续执行,为AI的行动力设置了不可逾越的安全边界。

全链路审计存证:从用户发起指令的那一刻起,平台就开始记录智能体的完整思考路径、调用的每一个工具、访问的每一份数据、生成的每一个结果。这些信息以不可篡改的形式实时存证,形成完整的审计链条,不仅满足合规要求,也为事后分析、模型优化和责任追溯提供了可靠的数据支撑。

资源治理与成本控制:XK-QianAI智能体开发平台提供强大的资源治理中心,支持多租户、多部门的Token消耗配额管理。通过智能模型路由功能,系统能够根据任务的复杂程度自动选择最优性价比的语言模型——简单查询调用轻量级模型,复杂分析启用旗舰模型,在保证效果的前提下将运营成本降至最低,避免资源失控带来的财务风险。

智能体评测与知识工程:让AI能力"看得见、管得住、用得好"

企业在引入AI智能体时,最大的顾虑往往是效果如何保证和知识如何沉淀。XK-QianAI智能体开发平台提供了业界领先的标准化智能体评测体系和全链路知识工程能力,让AI应用的性能可量化、可优化。

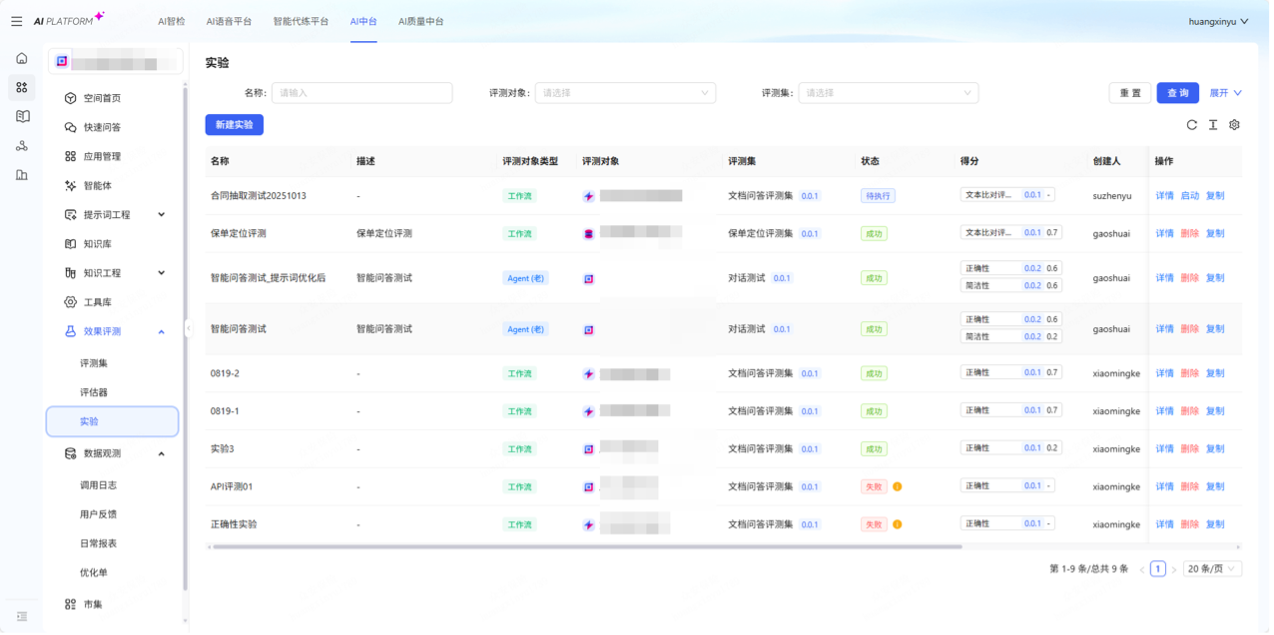

标准化评测体系:我们构建了涵盖评测集、评估器、实验三大模块的量化评测体系。评测集支持全生命周期管理与版本追溯,评估器可自定义规则进行文本比对和效果验证,实验模块可配置多维度参数并生成可视化结果与得分分析。这套体系彻底解决了智能体优化无据可依的问题,让每一次迭代都有数据支撑,确保AI应用性能始终处于可控状态。

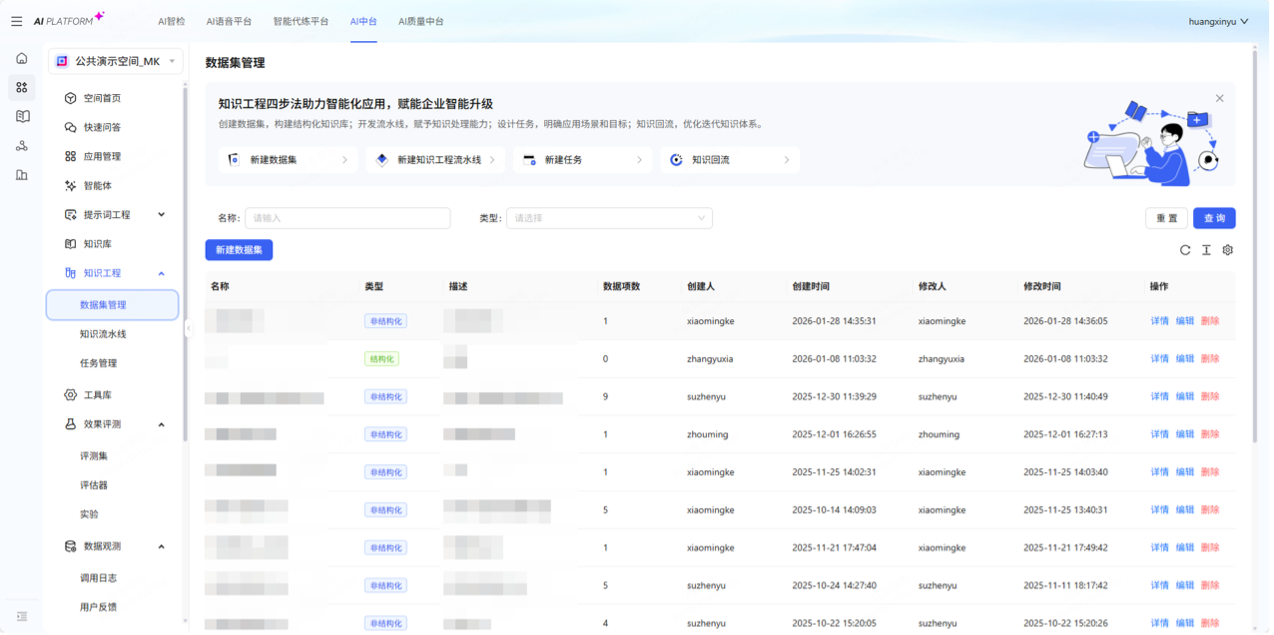

全链路知识工程:我们聚焦文档预处理全流程,通过"数据聚合-流水线处理-任务执行"的闭环机制,实现数据标准化处理与复用。平台支持结构化与非结构化双类型数据集的统一存储管理,可配置信息提取、格式转换、去水印等节点适配不同场景。绑定流水线与数据集后,系统可批量自动化预处理,结构化结果自动回流知识库,全程无需人工干预。这为AI智能体提供了高质量的知识支撑,确保其在执行任务时能够基于企业内部的规章制度、操作流程和合规要求进行精准执行,真正实现"戴着镣铐跳舞。

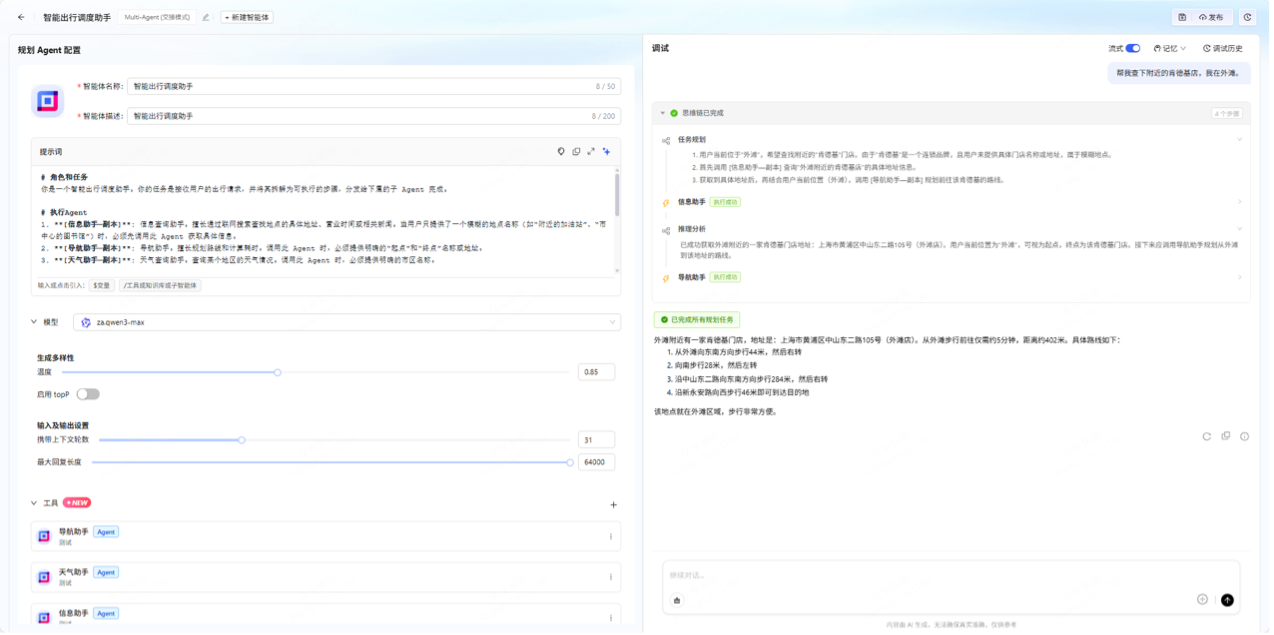

Agent与Multi-Agent协同:从单兵作战到团队协作

XK-QianAI智能体开发平台支持Agent与Multi-Agent协同能力,无需代码基础和流程化编排,智能体可自主思考规划、决策并调用工具或知识库完成任务拆解。Multi-Agent能够主动调度多个Agent协同工作,适配市场分析、报告生成、风险评估等复杂场景。系统支持React、Agent as Tools等模式完成自然语言编排,可拆分负载、优化效率、提升输出稳定性,并支持Agent级别的States管理,实现会话、用户、全局变量的统一控制。这种能力让企业能够构建真正的"数字员工团队",而非单一的工具。

结论

从OpenClaw的本地实验,到企业级的生产力跃迁,需要的不仅仅是技术的激情,更是对规则的敬畏和对风险的掌控。XK-QianAI智能体开发平台致力于弥合这道鸿沟,让AI智能体在合规的轨道上安全加速,为每一家企业打造真正"可信、可控、可用"的数字员工,稳健地驶向智能化未来。

"开源赋予智能体灵魂,我们赋予智能体规则。"

本文作者:众安信科 AI产品专家 Hangyu